Pattern-Kern

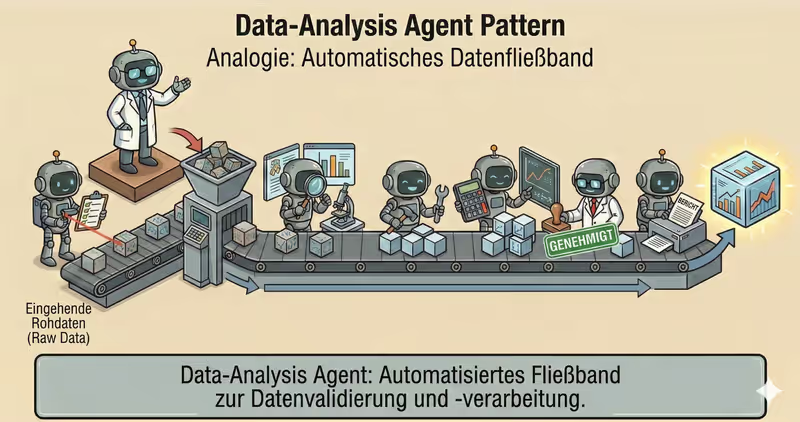

Data-Analysis Agent ist ein Pattern, in dem der Agent mit tabellarischen oder Zeitreihen-Daten uber eine gesteuerte Analyse-Pipeline arbeitet: policy check, ingest, profile, transform, analyze, validate, report.

Wann einsetzen: wenn Metriken auf realen Daten berechnet und gepruft werden mussen, statt sie nur allgemein zu beschreiben.

Im Unterschied zu "einfach antworten" fuhrt der Agent eine sequenzielle Analyse aus:

Ingest + profile: liest Daten und pruft DatenqualitatTransform: bereinigt Ausreisser und fehlende Werte nach RegelnAnalyze: berechnet Metriken, KPI und AggregateValidate: pruft Konsistenz der ErgebnisseReport: erstellt Schlussfolgerungen und Artefakte fur Audit

Problem

Stell dir vor, du fragst:

"Wie viel haben wir letzte Woche verdient?"

Du bekommst eine Zahl, verstehst aber nicht, was vor der Berechnung mit den Daten passiert ist.

Kritische Fragen bleiben offen:

- wurden Ruckerstattungen berucksichtigt

- wurden Duplikate entfernt

- wie wurden fehlende Werte behandelt

- ob Datenteile bei der "Bereinigung" verschwunden sind

Analyse ohne festen Prozess liefert Zahlen, die schwer erklarbar, prufbar und reproduzierbar sind.

Deshalb konnen verschiedene Personen denselben Datensatz unterschiedlich berechnen.

Genau das ist das Problem: ohne transparente Pipeline wird das Analyse-Ergebnis unvorhersehbar und nicht auditierbar.

Losung

Data-Analysis Agent arbeitet uber eine feste Analyse-Pipeline.

Analogie: wie eine Laboranalyse. Zuerst nimmt man eine Probe und pruft ihre Qualitat, dann berechnet man Kennzahlen. Ohne diese Reihenfolge sind Zahlen nicht vertrauenswurdig.

Kernprinzip: Wert liegt nicht nur in der Zahl, sondern darin, dass jeder Analyseschritt erklarbar und reproduzierbar ist.

Der Agent kann nicht "sofort rechnen" - er muss Schritte durchlaufen:

- Policy-Check: Zugriff auf Quelle prufen

- Ingest: Daten laden

- Profiling: Struktur und Qualitat prufen

- Transformation: nach Regeln bereinigen

- Analyse: Metriken berechnen

- Validierung: Ergebnis prufen

Und er protokolliert zwingend:

- Datenquelle

- Bereinigungsregeln

- ausgefuhrte Prufungen

- Daten-Einschrankungen

So kann man zum Beispiel zeigen:

- welche Zeilen entfernt wurden

- wie fehlende Werte behandelt wurden

- welche Ausreisser gefunden wurden

- welche Invarianten bestanden wurden

Funktioniert gut, wenn:

- Ingest-Schritt nicht ubersprungen werden kann

- Bereinigungsregeln festgelegt sind

- Validierungsschritt verpflichtend ist

- Ausfuhrungsschicht kein Umgehen der Pipeline-Schritte erlaubt

Verlassliche Analyse ist eine Pipeline, die der Agent technisch nicht umgehen kann.

Wie Es Funktioniert

Dieses Pattern nutzt oft Code-Execution Agent, um Berechnungen in einer Sandbox auszufuhren.

Wichtiger Unterschied: Fokus liegt hier nicht auf Code-Ausfuhrung an sich, sondern auf vollstandigem Analysezyklus mit Qualitats-Gates.

Voller Ablauf: Policy Check → Ingest → Profile → Transform → Analyze → Validate → Report

Policy-Check

Vor Verarbeitung pruft das System Quelle, Zugriffsrolle und Datensensitivitat (PII).

Ingest

Daten werden geladen mit Protokollierung von Quelle, Zeitraum und Version.

Profiling

Der Agent pruft schema, fehlende Werte, Duplikate und Ausreisser.

Transformation

Bereinigung und Normalisierung: Feldtypen, Filter, Behandlung von missing values.

Analyse

Berechnung von KPI, Aggregaten und Vergleichen.

Validierung

Das System pruft Invarianten: Metrik-Bereiche, keine negativen Werte, Konsistenz von Aggregaten.

Bericht

Ergebnis wird erstellt: Tabellen, Charts, Kernaussagen und Evidence.

Im Code Sieht Das So Aus

decision = policy_engine.evaluate_source(source, user_role=user_role)

if decision.type != "allow":

return stop_with_reason("source_policy_denied")

df = load_data(source)

profile = profile_data(df)

if profile.schema_mismatch:

return stop_with_reason("schema_mismatch")

df_clean = clean_data(df, rules=cleaning_rules)

metrics = compute_metrics(df_clean)

checks = validate_metrics(metrics, rules=[

"no_negative_revenue",

"conversion_between_0_1",

])

if not checks.ok:

return escalate_or_fallback(checks.errors)

report = build_report(metrics, checks, profile)

return report

Analyse-Ergebnis muss nicht nur Zahlen enthalten, sondern auch Evidence: welche Prufungen bestanden wurden und welche Daten-Einschrankungen vorlagen.

So Sieht Es Zur Laufzeit Aus

Goal: wochentliche Verkaufszusammenfassung erstellen

Ingest:

- sales.csv fur die letzten 7 Tage

Profile:

- 2% fehlende Werte in channel

- 1 Ausreisser in revenue

Transform:

- channel auffullen = "unknown"

- Duplikat id=8472 entfernen

Analyze:

- revenue: 142,300

- conversion: 3.84%

- top channel: paid_search

Validate:

- alle Invarianten bestanden

Report:

- KPI-Tabelle + kurze Schlussfolgerungen

Vollstandiges Data-Analysis-Agent-Beispiel

Wann Es Passt - Und Wann Nicht

Passt

| Situation | Warum Data-Analysis Passt | |

|---|---|---|

| ✅ | Regelmassige Analyse uber Datensatze | Pattern funktioniert gut fur systematische und wiederholbare Datenverarbeitung. |

| ✅ | Reproduzierbare Metriken | Pipeline sorgt fur stabile Ergebnisse zwischen Runs. |

| ✅ | Qualitatsprufungen sind vor Schlussfolgerungen verpflichtend | Validierungen und Invarianten reduzieren Risiko falscher Interpretation. |

| ✅ | Auditfahiges Ergebnis | Ergebnis und Verarbeitungsschritte sind transparent und prufbar. |

Passt Nicht

| Situation | Warum Data-Analysis Nicht Passt | |

|---|---|---|

| ❌ | Kleines Datenvolumen | Manuelle Analyse ist einfacher und gunstiger. |

| ❌ | Reine Textaufgabe | Ohne Berechnung und Prufungen ist Analyse-Pipeline uberflussig. |

| ❌ | Keine Ausfuhrungsinfrastruktur | Ohne Infrastruktur sind Validierung und Reproduzierbarkeit nicht sicherzustellen. |

Weil Data-Analysis Agent zusatzliches Engineering braucht: Pipeline, Prufungen, Monitoring und Versionsverwaltung von Quellen.

Unterschied Zu Code-Execution

| Code-Execution | Data-Analysis | |

|---|---|---|

| Rolle | Code sicher ausfuhren | Vollstandiger Analysezyklus auf Daten |

| Fokus | sandbox in Ausfuhrungsumgebung und Kontrolle vom Run | Qualitat von Metriken und analytischen Schlussfolgerungen |

| Output | Ergebnis der Code-Ausfuhrung | KPI, Prufungen, Schlussfolgerungen, Bericht |

| Hauptrisiko | Unsichere/instabile Ausfuhrung | Falsche Interpretation oder verschmutzte Daten |

Code-Execution ist ein Ausfuhrungsmechanismus. Data-Analysis ist ein Prozess fur verlassliche Analyse-Ergebnisse.

Wann Data-Analysis Verwenden (vs Andere Patterns)

Verwende Data-Analysis, wenn Daten untersucht und Schlussfolgerungen auf Basis von Analyse zuruckgegeben werden sollen.

Kurzer Test:

- wenn du "erklaren musst, was in Daten passiert, und Schlussfolgerungen liefern" -> Data-Analysis

- wenn du "nur Code ausfuhren und technischen Output bekommen" musst -> Code-Execution Agent

Vergleich mit anderen Patterns und Beispiele

Schneller Spickzettel:

| Wenn Aufgabe so aussieht... | Verwende |

|---|---|

| Nach jedem Schritt muss entschieden werden, was als nachstes folgt | ReAct Agent |

| Zuerst muss ein grosses Ziel in kleinere ausfuhrbare Aufgaben zerlegt werden | Task Decomposition Agent |

| Code muss ausgefuhrt, Ergebnisse gepruft und sicher iteriert werden | Code Execution Agent |

| Daten mussen untersucht und Schlussfolgerungen auf Analysebasis geliefert werden | Data Analysis Agent |

| Recherche uber mehrere Quellen mit strukturierten Belegen ist notig | Research Agent |

Beispiele:

ReAct: "Finde Ursache fur API-Ausfall: Logs prufen -> Fehler ansehen -> nachstes Check anhand Ergebnis starten".

Task Decomposition: "Neuen Tarif-Launch vorbereiten: Aufgabe in Subtasks fur Content, Technik, QA und Support zerlegen".

Code Execution: "Retention uber 12 Monate in Python berechnen und Korrektheit der Formeln auf realen Daten prufen".

Data Analysis: "Sales-CSV analysieren: Trends und Ausreisser finden und kurze Schlussfolgerungen liefern".

Research: "Daten uber 5 Wettbewerber aus mehreren Quellen sammeln und vergleichende Zusammenfassung erstellen".

Unsicher, ob dein Fall vor allem Data Analysis ist? Agent gestalten →

Wie Mit Anderen Patterns Kombinieren

- Data-Analysis + Code-Execution: wenn Daten gerechnet oder transformiert werden mussen, startet der Agent Code in sandbox mit Limits.

- Data-Analysis + Guarded-Policy: bei sensitiven Daten begrenzen Policies, welche Tabellen und Felder gelesen werden durfen.

- Data-Analysis + Fallback-Recovery: wenn Quelle oder Schritt ausfallt, wechselt Pipeline auf sicheren Recovery-Pfad.

Kurz

Data-Analysis Agent:

- Arbeitet mit Daten uber sequenzielle Pipeline

- Fugt Qualitatsprufungen zu jeder Stufe hinzu

- Liefert reproduzierbare Metriken und Schlussfolgerungen

- Reduziert Risiko von Fehlern in Business-Entscheidungen

Vorteile Und Nachteile

Vorteile

verarbeitet grosse Datenmengen schnell

hilft Trends und Ausreisser zu finden

Ergebnis kann gepruft und reproduziert werden

praktisch fur Berichte und Diagramme

Nachteile

ohne qualitativ gute Daten werden Schlussfolgerungen schwach

komplexe Berechnungen konnen langsam laufen

Prufung ist notig, um falsche Schlussfolgerungen zu vermeiden

FAQ

Q: Kann der Agent Analyse ohne Daten-Profiling machen?

A: Kann er, aber das ist riskant. Ohne profile-Schritt ubersieht man leicht Schema-Probleme und bricht Metriken.

Q: Warum Metriken nach Berechnung validieren?

A: Um Anomalien vor Versand zu finden: negatives revenue, conversion ausserhalb [0,1] und andere Invarianten.

Q: Ersetzt Data-Analysis Agent ein BI-System?

A: Nein. Er erganzt BI: automatisiert Ad-hoc-Analyse, Bereinigung und Erklarung, ersetzt aber nicht data governance.

Was Danach

Data-Analysis Agent arbeitet mit strukturierten Daten und reproduzierbaren Metriken.

Wie baut man einen Agenten fur open-world Recherche: Quellen finden, lesen, Fakten extrahieren und zitieren?