Essence Du Pattern

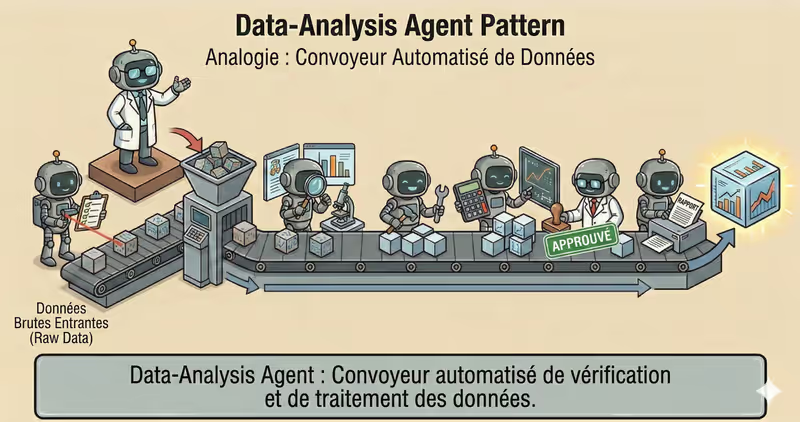

Data-Analysis Agent est un pattern ou l'agent travaille avec des donnees tabulaires ou temporelles via un pipeline analytique controle : policy check, ingest, profile, transform, analyze, validate, report.

Quand l'utiliser : quand il faut calculer et verifier des metriques sur des donnees reelles, et pas seulement les decrire en termes generaux.

Contrairement a "juste repondre", l'agent execute une analyse sequentielle :

Ingest + profile: lit les donnees et controle leur qualiteTransform: nettoie anomalies et valeurs manquantes selon des reglesAnalyze: calcule metriques, KPI et agregatsValidate: verifie la consistance des resultatsReport: produit conclusions et artefacts pour audit

Probleme

Imagine que tu demandes :

"Combien avons-nous gagne la semaine derniere ?"

Tu obtiens un nombre, mais tu ne sais pas ce qui a ete fait sur les donnees avant le calcul.

Des questions critiques restent :

- les remboursements sont-ils inclus

- les doublons ont-ils ete retires

- comment les valeurs manquantes ont ete traitees

- des parties de donnees ont-elles disparu pendant le "nettoyage"

Une analyse sans processus fixe donne des chiffres difficiles a expliquer, verifier et reproduire.

C'est pour cela que des personnes differentes peuvent calculer le meme dataset differemment.

C'est le probleme central : sans pipeline transparent, le resultat d'analyse devient imprevisible et non auditable.

Solution

Data-Analysis Agent fonctionne via un pipeline analytique fixe.

Analogie : c'est comme une analyse de laboratoire. D'abord on prend un echantillon et on controle sa qualite, puis on calcule les indicateurs. Sans cette sequence, les chiffres ne sont pas fiables.

Principe cle : la valeur n'est pas seulement dans le chiffre, mais dans le fait que chaque etape d'analyse est explicable et reproductible.

L'agent ne peut pas "calculer directement" - il suit des etapes :

- Policy check : verifier l'acces a la source

- Ingest : charger les donnees

- Profile : verifier structure et qualite

- Transform : nettoyer selon les regles

- Analyze : calculer les metriques

- Validate : verifier le resultat

Et il doit journaliser :

- source de donnees

- regles de nettoyage

- controles executes

- limites des donnees

Cela permet de montrer, par exemple :

- quelles lignes ont ete supprimees

- comment les valeurs manquantes ont ete traitees

- quelles anomalies ont ete detectees

- quelles invariantes ont ete validees

Fonctionne bien si :

- l'etape d'ingest ne peut pas etre sautee

- les regles de nettoyage sont fixees

- l'etape de validation est obligatoire

- la couche d'execution n'autorise pas le contournement des etapes pipeline

Une analyse fiable est un pipeline que l'agent ne peut pas contourner techniquement.

Comment Ca Fonctionne

Ce pattern utilise souvent Code-Execution Agent pour lancer les calculs en sandbox.

Difference cle : ici le focus n'est pas l'execution de code en soi, mais le cycle analytique complet avec gates de controle qualite.

Flow complet : Policy Check → Ingest → Profile → Transform → Analyze → Validate → Report

Policy Check

Avant traitement, le systeme verifie source, role d'acces et sensibilite des donnees (PII).

Ingest

Les donnees sont chargees avec trace de source, periode et version.

Profile

L'agent verifie schema, valeurs manquantes, doublons et outliers.

Transform

Nettoyage et normalisation : types de champs, filtres, traitement des missing values.

Analyze

Calcul des KPI, agregats et comparaisons.

Validate

Le systeme controle les invariantes : plages de metriques, absence de valeurs negatives, coherence des agregats.

Report

Le resultat est produit : tableaux, graphiques, conclusions cles et evidence.

En Code, Ca Donne Ca

decision = policy_engine.evaluate_source(source, user_role=user_role)

if decision.type != "allow":

return stop_with_reason("source_policy_denied")

df = load_data(source)

profile = profile_data(df)

if profile.schema_mismatch:

return stop_with_reason("schema_mismatch")

df_clean = clean_data(df, rules=cleaning_rules)

metrics = compute_metrics(df_clean)

checks = validate_metrics(metrics, rules=[

"no_negative_revenue",

"conversion_between_0_1",

])

if not checks.ok:

return escalate_or_fallback(checks.errors)

report = build_report(metrics, checks, profile)

return report

Le resultat analytique doit inclure non seulement les chiffres, mais aussi l'evidence : quels checks sont passes et quelles limites existaient dans les donnees.

A L'execution, Ca Ressemble A Ca

Goal: preparer le resume hebdomadaire des ventes

Ingest:

- sales.csv sur les 7 derniers jours

Profile:

- 2% de valeurs manquantes dans channel

- 1 outlier sur revenue

Transform:

- remplir channel = "unknown"

- supprimer doublon id=8472

Analyze:

- revenue: 142,300

- conversion: 3.84%

- top channel: paid_search

Validate:

- toutes les invariantes sont validees

Report:

- tableau KPI + conclusions courtes

Exemple complet d'agent Data-Analysis

Quand Ca Convient - Et Quand Non

Adapte

| Situation | Pourquoi Data-Analysis Convient | |

|---|---|---|

| ✅ | Analytique reguliere sur des datasets | Le pattern fonctionne bien pour un traitement systematique et repetable des donnees. |

| ✅ | Metriques reproductibles | Le pipeline assure la stabilite des resultats entre executions. |

| ✅ | Checks qualite obligatoires avant conclusions | Validations et invariantes reduisent le risque d'interpretation incorrecte. |

| ✅ | Resultat auditable | Resultat et etapes de traitement sont transparents et verifiables. |

Non Adapte

| Situation | Pourquoi Data-Analysis Ne Convient Pas | |

|---|---|---|

| ❌ | Petit volume de donnees | L'analyse manuelle sera plus simple et moins couteuse. |

| ❌ | Tache purement textuelle | Sans calculs ni checks, le pipeline analytique est superflu. |

| ❌ | Pas d'infrastructure d'execution | Sans infrastructure, validation et reproductibilite ne peuvent pas etre garanties. |

Parce que Data-Analysis Agent demande de l'ingenierie supplementaire : pipeline, checks, monitoring et versioning des sources.

Difference Avec Code-Execution

| Code-Execution | Data-Analysis | |

|---|---|---|

| Role | Executer du code en securite | Cycle analytique complet sur les donnees |

| Focus | sandbox dans l'environnement d'execution et controle du run | Qualite des metriques et conclusions analytiques |

| Output | Resultat d'execution de code | KPI, checks, conclusions, rapport |

| Risque principal | Execution dangereuse/instable | Interpretation incorrecte ou donnees sales |

Code-Execution est un mecanisme d'execution. Data-Analysis est un processus pour obtenir un resultat analytique fiable.

Quand Utiliser Data-Analysis (vs Autres Patterns)

Utilisez Data-Analysis quand il faut explorer des donnees et retourner des conclusions basees sur l'analyse.

Test rapide :

- si vous devez "expliquer ce qui se passe dans les donnees et donner des conclusions" -> Data-Analysis

- si vous devez "simplement executer du code et obtenir un output technique" -> Code-Execution Agent

Comparaison avec d'autres patterns et exemples

Aide-memoire rapide :

| Si la tache ressemble a cela... | Utilisez |

|---|---|

| Apres chaque etape, il faut decider quoi faire ensuite | ReAct Agent |

| D'abord il faut decouper un grand objectif en petites taches executables | Task Decomposition Agent |

| Il faut executer du code, verifier les resultats et iterer en securite | Code Execution Agent |

| Il faut explorer les donnees et retourner des conclusions basees sur l'analyse | Data Analysis Agent |

| Il faut de la recherche multi-sources avec des preuves structurees | Research Agent |

Exemples :

ReAct : "Trouve la cause d'une panne API : verifier logs -> voir erreurs -> lancer check suivant selon resultat".

Task Decomposition : "Preparer lancement d'une nouvelle offre : decouper en sous-taches contenu, technique, QA et support".

Code Execution : "Calculer la retention sur 12 mois en Python et verifier les formules sur des donnees reelles".

Data Analysis : "Analyser un CSV de ventes : trouver tendances, anomalies et donner des conclusions courtes".

Research : "Collecter des donnees sur 5 concurrents depuis plusieurs sources et produire un resume comparatif".

Pas sûr que votre cas relève surtout de Data Analysis ? Concevoir votre agent →

Comment Combiner Avec D'autres Patterns

- Data-Analysis + Code-Execution : quand il faut calculer ou transformer des donnees, l'agent lance du code en sandbox avec limites.

- Data-Analysis + Guarded-Policy : si les donnees sont sensibles, les policies limitent quelles tables et champs peuvent etre lus.

- Data-Analysis + Fallback-Recovery : si source ou etape echoue, le pipeline bascule sur un scenario de recuperation sur.

En Bref

Data-Analysis Agent:

- Travaille sur les donnees via un pipeline sequentiel

- Ajoute des checks qualite a chaque etape

- Retourne des metriques et conclusions reproductibles

- Reduit le risque d'erreurs dans les decisions metier

Avantages Et Inconvenients

Avantages

traite rapidement de gros volumes de donnees

aide a trouver tendances et anomalies

le resultat peut etre verifie et reproduit

pratique pour construire rapports et graphiques

Inconvenients

sans donnees de qualite, les conclusions seront faibles

les calculs complexes peuvent etre lents

des checks sont necessaires pour eviter des conclusions fausses

FAQ

Q: L'agent peut-il faire une analyse sans profilage des donnees ?

A: Oui, mais c'est risque. Sans etape profile, on peut facilement manquer des problemes de schema et casser les metriques.

Q: Pourquoi valider les metriques apres calcul ?

A: Pour attraper les anomalies avant envoi du resultat : revenue negatif, conversion hors [0,1] et autres invariantes.

Q: Data-Analysis Agent remplace-t-il un systeme BI ?

A: Non. Il complete BI : automatise analyse ponctuelle, nettoyage et explication, mais ne remplace pas data governance.

Et Ensuite

Data-Analysis Agent travaille avec des donnees structurees et des metriques reproductibles.

Comment construire un agent pour la recherche open-world : trouver des sources, lire, extraire des faits et citer ?