Wenn Menschen zum ersten Mal sehen, wie ein Agent selbst arbeitet, haben sie fast immer eine Reaktion:

"Denkt er wirklich selbst?"

Von außen sieht das wirklich beeindruckend aus. Du klickst nichts, gibst keinen nächsten Schritt vor und führst den Prozess nicht an der Hand, und trotzdem macht das System etwas.

Es probiert eine Option, sie klappt nicht. Es sucht eine andere. Es ändert den Ansatz. Und am Ende kommt es mit einem Ergebnis zurück.

In diesem Moment glaubt man leicht, dass innen irgendeine Magie passiert. Aber hier gibt es keine Magie. Es gibt eine ziemlich einfache Logik.

Ein Agent "denkt" nicht wie ein Mensch, er arbeitet in einem Loop

Wenn wir sagen, dass ein Agent "denkt", beschreiben wir in Wirklichkeit ein Gefühl, nicht das, was tatsächlich passiert.

Von außen wirkt es wie Denken: Das System scheint zu stoppen, etwas zu "überlegen", und macht dann einen sinnvollen Schritt. Aber innen ist alles einfacher.

Er wiederholt einfach einen Prozess:

Und wieder.

Von außen wirkt das wie "intelligentes Verhalten". Aber in Wirklichkeit ist das ein Loop, kein Denken.

Dasselbe Prinzip wie bei einem Menschen, der eine geschlossene Tür öffnen will: erst ziehen, dann drücken, dann einen Schlüssel suchen. Nicht weil er einen perfekten Plan ausgearbeitet hat, sondern weil er Varianten ausprobiert, bis etwas funktioniert.

Gerade wegen dieses Loops bricht der Agent nicht beim ersten Fehler. Er erwartet nicht, dass alles nach Plan läuft. Für ihn ist ein Fehler nur ein weiterer Zustand, von dem aus er weitergeht.

Ein Agent kann manchmal einen Plan machen, aber selbst dann führt er ihn nicht sofort komplett aus.

Er bewegt sich trotzdem im Loop: Situation bewerten -> Aktion auswählen -> Ergebnis prüfen -> und bei Bedarf den Plan ändern.

Loop-Struktur: wie ein Agent vorankommt

Trotz aller "Magie" ist der Agent-Loop sehr einfach. Er besteht aus mehreren Schritten, die sich ständig wiederholen.

- Situation verstehen Der Agent schaut auf den aktuellen Stand: welche Daten verfügbar sind, was schon gemacht wurde, was schiefgelaufen ist. Das ist keine tiefe Analyse, nur eine Zustandsaufnahme.

"Okay, ich bin hier. Was habe ich?"

-

Nächsten Schritt auswählen Darauf basierend wählt er eine Aktion, die genau jetzt sinnvoll ist. Nicht die beste in der Theorie. Nicht perfekt. Einfach der nächste vernünftige Versuch.

-

Aktion Er macht, was er ausgewählt hat: ruft ein Tool auf, arbeitet mit Daten, verändert die Situation. Es gibt keine Garantie, dass es klappt. Das ist ein Versuch, kein Plan.

-

Ergebnis prüfen Nach der Aktion schaut der Agent, was sich geändert hat. Näher am Ziel ist gut, weiter. Neue Information heißt Kurs anpassen. Blockierter Weg heißt einen anderen suchen.

Und wieder, im Kreis. Bis ein Ergebnis da ist. Oder bis der Agent an eine Grenze stößt, die er nicht mehr überschreiten kann.

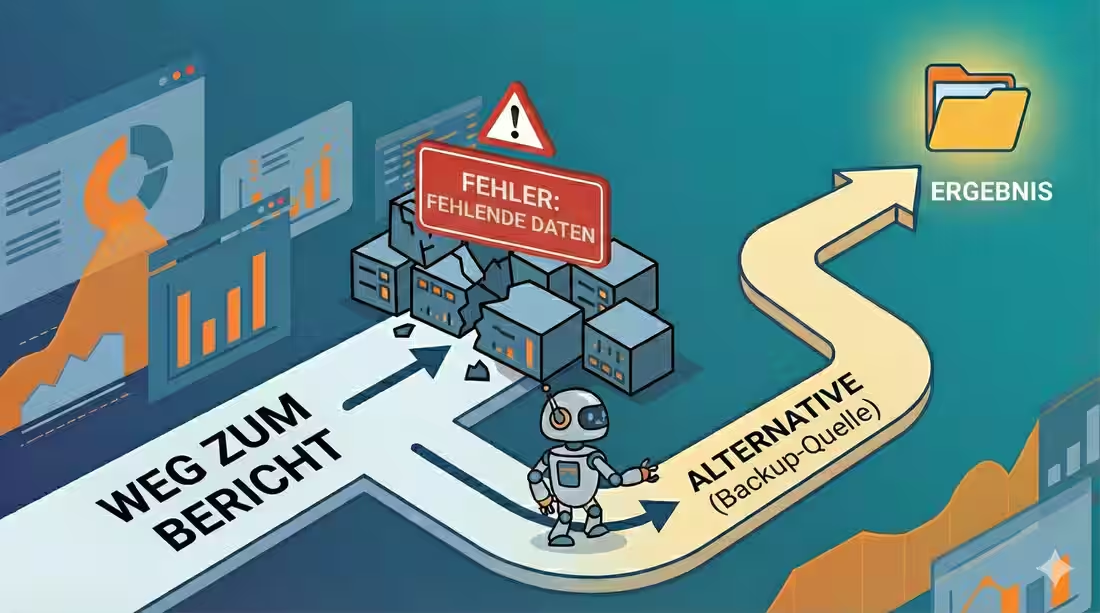

Praxisbeispiel: wie ein Agent den Loop bei einer realen Aufgabe durchläuft

Stell dir eine einfache Aufgabe vor. Du sagst dem Agenten:

"Mach bis heute Abend einen Ausgabenbericht für die letzte Woche."

Keine Anweisungen. Keine Schritte. Nur das Ergebnis. So läuft es dann weiter, Schritt für Schritt.

Loop 1: Situation verstehen

Der Agent beginnt mit einem Überblick über das, was da ist. Wo könnten Ausgabendaten sein: in einer Datenbank, in Dateien, in einem Analytics-Service?

Er findet die Hauptquelle, das Abrechnungssystem, und sieht ein Problem: Ein Teil der Daten vom Dienstag fehlt.

Das ist kein Fehler. Das ist einfach der aktuelle Zustand.

Loop 2: Nächsten Schritt auswählen

Der Agent stoppt nicht und schreibt nicht: "Was soll ich tun?"

Er wählt einen naheliegenden Versuch: eine Backup-Quelle prüfen. Vielleicht sind die Daten in Logs. Vielleicht in einem anderen Service. Vielleicht im Cache.

Das ist keine perfekte Lösung. Das ist einfach der nächste vernünftige Schritt.

Loop 3: Aktion

Der Agent fragt System-Logs ab, um fehlende Daten zu holen.

Ergebnis: einen Teil findet er. Einen Teil nicht.

Er kombiniert, was er hat, und sieht: Für einen vollständigen Bericht fehlen noch mehrere Werte vom Dienstag.

Loop 4: Prüfen und neue Entscheidung

Der Agent schaut auf das Gesamtbild. Der Bericht ist fast fertig, aber es gibt Lücken.

Jetzt hat er mehrere Optionen:

- noch eine Quelle versuchen

- Daten ungefähr schätzen

- festhalten, dass ein Teil der Information nicht verfügbar ist

Er wählt die dritte Option: den Bericht mit einem Hinweis auf fehlende Daten abschließen. So kann er weitergehen, ohne zu lügen.

Loop 5: Finale Aktion

Der Agent erstellt den Bericht: Tabelle der Wochenausgaben, Trenddiagramm, Fazit.

Im Hinweis schreibt er: "Daten für den 8. Oktober (Dienstag) sind wegen eines Ausfalls im Abrechnungssystem teilweise nicht verfügbar. Der Bericht basiert auf den verfügbaren 87% der Datensätze."

Er speichert die Datei. Fertig.

Zurück zu dir

Der Agent schreibt: "Bericht ist fertig. Daten der letzten Woche wurden gesammelt, ein Teil der Dienstagsdaten war nicht verfügbar und wurde im Hinweis dokumentiert. Datei im Anhang."

Was hier wichtig ist

Zu keinem Zeitpunkt hat der Agent:

- auf den nächsten Befehl gewartet

- wegen eines Fehlers "abgestürzt"

- gestoppt, weil etwas nicht perfekt war

Er ist einfach den Loop wieder und wieder durchlaufen, bis er unter diesen Bedingungen das bestmögliche Ergebnis erreicht hat.

Darum wirkt es von außen so, als würde der Agent "denken". Aber in Wirklichkeit denkt er nicht, er hört nicht auf.

Kurz gesagt

Ein KI-Agent ist nicht nützlich, weil er "denkt". Und nicht, weil er immer alles richtig macht. Er ist nützlich, weil er nicht aufhört, wenn etwas nicht nach Plan läuft. Ein Agent kennt den idealen Weg nicht im Voraus. Er bewegt sich einfach zum Ziel und prüft ständig, was funktioniert hat und was nicht. Ein Fehler ist für ihn kein Scheitern und kein Grund, auf einen Menschen zu warten, sondern ein weiterer Zustand, aus dem er den nächsten Schritt machen kann. Genau diese Hartnäckigkeit erzeugt das Gefühl von "intelligentem Verhalten". Keine Magie. Kein Bewusstsein. Nur ein Loop, der beim ersten Fehlschlag nicht abbricht.

FAQ

Q: Denkt ein Agent wirklich nach, bevor er etwas macht?

A: Nein. Was wie Denken aussieht, ist die Wiederholung des Loops: Zustand bewerten -> Aktion auswählen -> Ergebnis prüfen.

Q: Was passiert, wenn eine Aktion nicht funktioniert?

A: Der Agent prüft das Ergebnis und probiert im nächsten Loop eine andere Option.

Q: Wann beendet der Agent seine Arbeit?

A: Wenn ein Ergebnis erreicht ist oder wenn weitere Aktionen keinen Sinn mehr ergeben.

Wie geht es weiter

Jetzt, wo du verstehst, wie ein Agent im Loop arbeitet und warum er beim ersten Fehler nicht stoppt, ist es Zeit für den nächsten Schritt.

Gehen wir in die Praxis: Bauen wir deinen ersten KI-Agenten