Esencia del patron

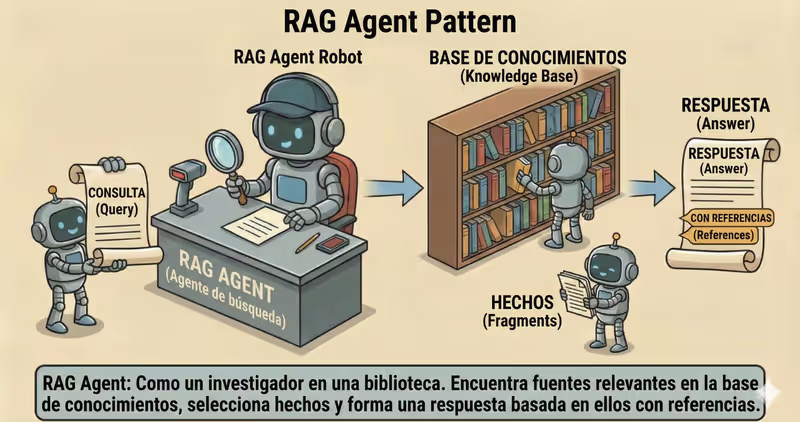

RAG Agent es un patron en el que el agente primero encuentra fuentes relevantes y luego genera la respuesta basandose en ellas, en lugar de depender solo de la memoria parametrica del modelo.

Cuando usarlo: cuando la respuesta debe apoyarse en documentos actuales y referencias, no solo en memoria del modelo.

En lugar de responder "desde la cabeza del modelo", RAG agrega un paso dedicado:

- encontrar hechos en la base de conocimiento

- seleccionar los fragmentos mas relevantes

- responder con citas de fuente

Problema

Imagina que un usuario pregunta:

"Cual es el SLA para el plan enterprise?"

El agente responde sin paso de retrieval, solo desde memoria del modelo.

El texto puede sonar seguro, pero estar debilmente verificado:

- valor desactualizado de una version anterior de policy

- hechos mezclados de documentos distintos

- ausencia de fuente para verificar

- redaccion "precisa" sin evidencia

Sin busqueda controlada, incluso una respuesta plausible puede no estar sustentada.

Esto es especialmente riesgoso para support, compliance, policies internas y documentacion tecnica.

Ese es el problema central: sin anclaje a fuentes, el agente puede dar una respuesta convincente pero no verificada, dificil de auditar.

Solucion

RAG agrega una grounding-policy que gobierna la busqueda antes de generar.

Analogia: es como responder con un libro abierto. Primero encuentras las paginas correctas, luego formulas la respuesta. Si no hay fuentes, es mejor pedir aclaracion que inventar.

Principio clave: primero encontrar y verificar fuentes, luego generar la respuesta.

El agente puede proponer texto, pero la grounding-policy define:

- que fuentes son validas

- que se puede incluir en la respuesta

- cuando hace falta fallback en lugar de "completar de memoria"

Proceso controlado:

- Retrieve: encontrar fragmentos relevantes

- Ranking/filtrado: quitar ruido y duplicados

- Anclaje a fuentes: armar contexto permitido

- Generacion: responder solo dentro de ese contexto

- Citas: adjuntar links/metadata a las afirmaciones

Esto te da:

- menor riesgo de alucinaciones en consultas factuales

- respuestas ancladas a documentos

- verificabilidad y auditabilidad

- respuestas mas actuales cuando cambian los documentos

Funciona bien si:

- retrieval tiene un indice de calidad + metadata

- ranking filtra ruido de forma estable

- el modelo no responde fuera del contexto anclado

- cuando faltan fuentes, se activa un fallback seguro

El modelo puede "querer" responder de memoria, pero la capa RAG decide si la base de evidencia es suficiente.

Como funciona

RAG no reemplaza al agente. Agrega una capa de conocimiento antes de la generacion de respuesta.

Idea clave: si no hay contexto relevante, el sistema no debe "inventar una respuesta".

Descripcion completa del flujo: Retrieve → Ground → Generate → Cite

Retrieve

El sistema busca candidatos en la base de conocimiento segun la consulta del usuario.

Anclaje a fuentes

Los fragmentos seleccionados se pasan como unico contexto permitido para generar la respuesta.

Generacion

El agente formula la respuesta solo a partir de ese contexto. Cualquier informacion fuera de el se considera no permitida.

Citas

El resultado final incluye fuentes: enlace, nombre de documento, version o timestamp.

En codigo se ve asi

chunks = retrieve(goal, top_k=8, filters={"tenant_id": tenant_id})

context = rerank_and_pack(goal, chunks, max_tokens=2500)

if not context:

return ask_clarifying_or_fallback(goal) # sin contexto relevante, no generamos respuesta

answer = generate_grounded_answer(goal, context) # generar solo desde fuentes encontradas

answer = attach_citations(answer, context)

return answer

Como se ve durante la ejecucion

Goal: Cual es el SLA para el plan enterprise?

Retrieve:

- se encontraron 6 fragmentos en policies de soporte

- despues de rerank quedaron 2 relevantes

- si fragmentos relevantes = 0 -> pregunta de aclaracion / fallback en lugar de respuesta inventada

Ground:

- contexto construido con dos extractos

- metadata agregada: doc_id, section, updated_at

Generate:

- respuesta generada solo con esas fuentes

Cite:

- enlace agregado a "Support Policy v3.2"

Ejemplo completo de agente RAG

Cuando encaja - y cuando no

Encaja

| Situacion | Por que RAG encaja | |

|---|---|---|

| ✅ | Importan la precision factual y las fuentes | RAG vincula la respuesta a documentos concretos y facilita la verificacion. |

| ✅ | El conocimiento cambia con frecuencia | La busqueda trae datos actualizados sin reentrenar el modelo. |

| ✅ | La respuesta debe basarse en materiales internos | RAG permite usar documentos corporativos como base de la respuesta. |

| ✅ | Necesitas reducir alucinaciones | El contexto anclado reduce respuestas sin respaldo factual. |

| ✅ | El resultado debe ser auditable | Puedes registrar fuentes recuperadas y explicar en que se basa la respuesta. |

No encaja

| Situacion | Por que RAG no encaja | |

|---|---|---|

| ❌ | La tarea no depende de conocimiento externo | La capa de busqueda agrega costo sin mejora visible del resultado. |

| ❌ | No hay base de conocimiento ni metadata de calidad | Un indice debil y documentos pobres producen retrieval irrelevante. |

| ❌ | Solo necesitas generacion corta sin fact-checking | En ese caso, RAG complica el sistema y aumenta la latencia. |

Porque RAG agrega pasos extra de indexacion, busqueda y ranking.

Diferencia frente a ReAct

| ReAct | RAG | |

|---|---|---|

| Rol principal | Toma de decisiones paso a paso | Inyectar conocimiento relevante en el contexto |

| Pregunta clave | Que hacemos despues? | En que fuentes debe basarse la respuesta? |

| Foco | Acciones y herramientas | Hechos y generacion anclada |

| Riesgo sin guardrails | Llamadas de herramientas excesivas o bucles | Alucinaciones con busqueda debil |

ReAct controla el loop de acciones del agente.

RAG controla la calidad del conocimiento en que se construye la respuesta.

Cuando usar RAG (vs otros patrones)

Usa RAG cuando la respuesta debe apoyarse en documentos externos o una base de conocimiento en la consulta actual.

Test rapido:

- si necesitas "encontrar fuentes relevantes y responder en base a ellas" -> RAG

- si necesitas "recordar contexto del usuario entre pasos o sesiones" -> Memory-Augmented Agent

Comparacion con otros patrones y ejemplos

Guia rapida:

| Si la tarea se ve asi... | Usa |

|---|---|

| Necesitas encontrar conocimiento en fuentes externas y construir la respuesta con eso | RAG Agent |

| Necesitas guardar y usar contexto de usuario entre pasos o sesiones | Memory-Augmented Agent |

Ejemplos:

RAG: "Responde preguntas del cliente solo con la base interna de policy y muestra las fuentes."

Memory-Augmented: "Recuerda que el cliente ya eligio el plan Pro y tenlo en cuenta en las siguientes respuestas."

No sabes si tu caso realmente necesita RAG y conocimiento externo? Diseñar tu agente →

Como combinar con otros patrones

- RAG + ReAct: primero el agente recupera hechos de las fuentes y luego ejecuta pasos sobre contexto verificado.

- RAG + Supervisor: si faltan fuentes validas, la respuesta se bloquea o va a aprobacion.

- RAG + Multi-Agent Collaboration: todos los agentes comparten el mismo knowledge context y trabajan de forma consistente.

Resumen

RAG Agent:

- Busca fragmentos de conocimiento relevantes

- Construye la respuesta en base a ellos

- Agrega citas de fuente

- Reduce el riesgo de alucinaciones

Ventajas y Desventajas

Ventajas

responde en base a tus documentos

menos invenciones del modelo

permite mostrar fuentes en la respuesta

el conocimiento se actualiza sin reentrenar el modelo

Desventajas

la calidad depende del indice y del chunking

la base de conocimiento requiere mantenimiento

sin filtros, puede traer fragmentos irrelevantes

FAQ

Q: RAG garantiza una respuesta 100% correcta?

A: No. RAG reduce el riesgo de error, pero la calidad depende del indice, retrieval y ranking.

Q: Que hacer si no se encuentran fuentes relevantes?

A: Necesitas un fallback seguro: pregunta de aclaracion, rechazo con motivo o escalacion humana.

Q: RAG reemplaza el fine-tuning?

A: No. RAG resuelve acceso a conocimiento actualizado. Fine-tuning cambia estilo o comportamiento del modelo. En produccion suelen combinarse.

Que sigue

RAG le da al agente conocimiento externo actualizado para la consulta actual.

Pero como conservar contexto de interaccion util entre sesiones de usuario?